Co to jest Cloud GPU?

Chmurowy GPU zapewnia potężne przetwarzanie grafiki przez internet, oferując szybkie, skalowalne obliczenia dla AI, uczenia maszynowego, renderowania i obciążeń o wysokiej wydajności. Usuwa potrzebę posiadania sprzętu na miejscu i wspiera elastyczną, na żądanie wydajność w szerokim zakresie zadań.

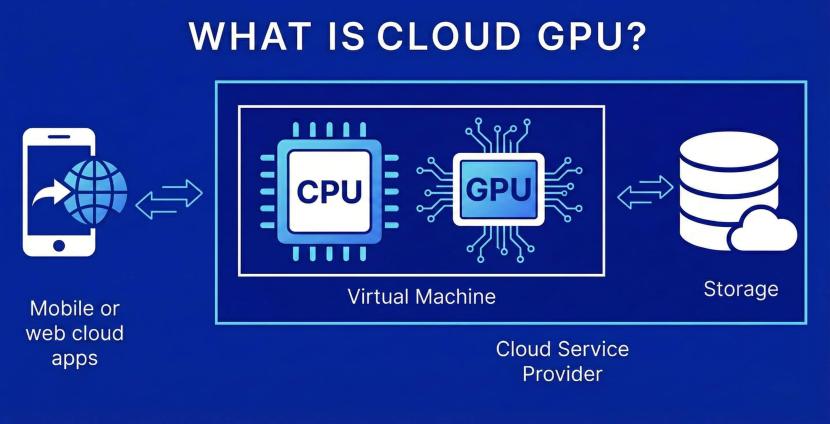

Jak działa chmurowy GPU?

Chmurowy GPU to w zasadzie zdalny procesor graficzny, który można używać przez internet, aby zwiększyć wydajność w wymagających obciążeniach. Zamiast kupować drogi sprzęt samodzielnie, po prostu korzystasz z dostawcy, który daje ci dostęp do mocnych GPU na żądanie. To łatwy, przystępny sposób, aby dać swoim aplikacjom — szczególnie ciężkim obciążeniom, takim jak modele AI, uczenie maszynowe lub prace 3D — poważną moc obliczeniową bez kupowania drogiego sprzętu na miejscu.

Za kulisami, chmurowe GPU działają, wykorzystując coś, co nazywa się wirtualizacją GPU. Pozwala to dostawcy chmury podzielić fizyczne karty GPU na wiele bezpiecznych, izolowanych części, z których każda staje się swoją własną „instancją”, z własną pamięcią i mocą obliczeniową. W rezultacie możesz wybrać dowolny rozmiar, który odpowiada twojemu obciążeniu, niezależnie od tego, czy testujesz na małą skalę, czy uruchamiasz bardziej wymagające zadania szkoleniowe i skalujesz w razie potrzeby.

Korzystanie z chmurowego GPU jest proste. Możesz uzyskać do niego dostęp przez API, pulpity nawigacyjne lub narzędzia automatyzacji, co ułatwia integrację z istniejącymi procesami. Dzięki chmurowym GPU możesz zarządzać wszystkimi swoimi zadaniami zdalnie — od modeli AI po renderowanie 3D i symulacje o wysokiej wydajności. Ta elastyczność jest szczególnie przydatna podczas eksperymentowania z różnymi aplikacjami lub migracji z starszych środowisk.

Innym powodem, dla którego chmurowe GPU są szczególnie przydatne, jest to, jak łatwo łączą się z innymi usługami chmurowymi. Możesz je połączyć z przechowywaniem online, narzędziami sieciowymi lub nawet platformami multi-cloud, aby zbudować elastyczne infrastruktury AI, które skalują się w miarę zmiany twoich potrzeb. Wiele zespołów preferuje tę opcję, ponieważ zmniejsza koszty i złożoność zakupu, utrzymania i modernizacji fizycznego sprzętu. I w przeciwieństwie do GPU na miejscu, chmurowe GPU oszczędzają ci kłopotów związanych z przestrzenią, elektrycznością, chłodzeniem i bieżącymi kosztami.

Zrozumienie kluczowych różnic: Architektura CPU vs GPU

CPU i GPU obie zajmują się przetwarzaniem, ale są zbudowane do zupełnie różnych podejść do obliczeń. CPU jest dobrze przystosowane do obsługi szerokiego zakresu aplikacji ogólnego przeznaczenia, często zajmując się zadaniami, które wymagają logiki sekwencyjnej lub konkretnych instrukcji. GPU, z drugiej strony, błyszczy, gdy potrzebujesz ogromnej mocy przetwarzania równoległego i jest idealne do grafiki, symulacji, uczenia maszynowego i modeli AI, które polegają na tysiącach małych równoczesnych obliczeń.

Oto prosta tabela przedstawiająca różnice architektoniczne:

| Funkcje | CPU | GPU |

| Projekt rdzenia | Kilka rdzeni o wysokiej wydajności zaprojektowanych do zadań sekwencyjnych | Setki lub tysiące mniejszych rdzeni zoptymalizowanych do przetwarzania równoległego |

| Najlepiej nadaje się do | Aplikacji ogólnego przeznaczenia, zarządzania systemem i zadań wymagających logiki | Sztucznej inteligencji, uczenia maszynowego, renderowania, symulacji i obciążeń o wysokiej wydajności |

| Zarządzanie pamięcią | Dostęp o niskim opóźnieniu dla szybkiego podejmowania decyzji | Pamięć o wysokiej przepustowości dla dużych zbiorów danych i modeli |

| Przetwarzanie | Wykonuje jedno lub kilka złożonych zadań jednocześnie | Wykonuje tysiące lekkich zadań jednocześnie |

| Elastyczność | Bardzo elastyczne w przypadku różnych zadań obliczeniowych | Bardzo wydajne w przypadku powtarzalnych, równoległych zadań |

GPU w chmurze vs fizyczny GPU

GPU Cloud

- Oferuje wydajność na żądanie z skalowalnymi GPU do zmieniających się obciążeń.

- Brak początkowej inwestycji w sprzęt ani bieżących kosztów utrzymania.

- Łatwe do rozszerzenia mocy obliczeniowej podczas szkolenia AI, renderowania lub dużych aplikacji.

- Integruje się bezproblemowo z środowiskami chmurowymi, narzędziami automatyzacji i platformami wielochmurowymi.

- silna alternatywa dla lokalnych GPU, gdy potrzebujesz większej elastyczności, szybszej konfiguracji i mniejszych kosztów operacyjnych.

Fizyczny GPU

- Pełna własność sprzętu, ale stałe zasoby i ograniczona skalowalność.

- Wyższe długoterminowe koszty z powodu energii elektrycznej, chłodzenia i modernizacji komponentów.

- Wymaga ręcznego zarządzania bezpieczeństwem, poprawkami i niezawodnością infrastruktury.

- Lepiej nadaje się do bardzo specyficznych lub stałych wymagań dotyczących obciążenia, gdzie użycie nie waha się.

- Mniej elastyczne niż instancje oparte na chmurze, szczególnie dla zespołów prowadzących procesy uczenia maszynowego lub wiele modeli.

Zalety GPU w chmurze

Wysoka wydajność dla obciążeń obliczeniowych.

GPU w chmurze oferują mocne, niezawodne osiągi dla wymagających aplikacji, takich jak modele AI, uczenie maszynowe, renderowanie i symulacje. Korzystając z potężnych GPU hostowanych przez dostawcę chmury, uzyskujesz moc obliczeniową, której potrzebujesz, bez modernizacji lokalnego sprzętu.

Skalowalność na żądanie:

W miarę jak twoje obciążenia rosną — od testowania nowych modeli po obsługę skoków w przetwarzaniu danych — możesz skalować zasoby GPU w kilka sekund. Taki poziom elastyczności po prostu nie jest możliwy z użyciem stałego sprzętu lokalnego.

Efektywność kosztowa i zmniejszona inwestycja w sprzęt.

GPU w chmurze eliminują koszty początkowe fizycznych kart oraz bieżące koszty chłodzenia, energii i konserwacji. Płacisz tylko za to, co używasz, co pomaga lepiej planować budżet i ułatwia porównywanie cen lub planowanie migracji z starszej infrastruktury.

Szybsze wdrożenie i zmniejszona konserwacja.

Ponieważ dostawca chmury zarządza instalacją, aktualizacjami i bezpieczeństwem, wdrożenie jest szybkie i proste. Możesz uruchamiać instancje do testowania, szkolenia AI lub cięższych obciążeń bez jakiejkolwiek fizycznej konfiguracji, co pozwala zespołom skupić się na budowaniu aplikacji, a nie zarządzaniu sprzętem.

Popularne przypadki użycia dla Cloud GPU

Obciążenia AI i uczenia maszynowego

Cloud GPU są idealne do trenowania modeli AI i przeprowadzania eksperymentów ML, które wymagają dużej wydajności i szybkiego przetwarzania. Pozwalają na obsługę dużych zbiorów danych, testowanie różnych architektur i skalowanie zasobów w miarę wzrostu obciążenia — wszystko to bez konieczności zakupu specjalistycznego sprzętu.

Renderowanie 3D i aplikacje intensywnie wykorzystujące grafikę

Artyści, projektanci i deweloperzy korzystają z cloud GPU, aby przyspieszyć renderowanie i efekty wizualne. Dzięki potężnym GPU dostępnym na żądanie, możesz skrócić czasy oczekiwania, uruchamiać wiele projektów jednocześnie i pracować płynnie w różnych platformach i środowiskach.

Wysoko wydajne systemy obliczeniowe (HPC - High-performance computing)

Dla badań naukowych, symulacji i innych zadań wymagających dużej mocy obliczeniowej, cloud GPU zapewniają moc i skalowalność potrzebną do szybkiego przetwarzania złożonych obliczeń. Są praktyczną opcją dla zespołów, które chcą niezawodnej wydajności bez zarządzania własną infrastrukturą HPC.

Analiza dużych danych i symulacje

Cloud GPU doskonale radzą sobie z obsługą ogromnych wolumenów danych, co czyni je przydatnymi do analizy, prognozowania i symulacji na dużą skalę. Łącząc przetwarzanie GPU z innymi usługami chmurowymi, organizacje mogą szybciej odkrywać wnioski i dostosowywać pojemność do szczytowego wykorzystania.

Rozważania dotyczące bezpieczeństwa i zgodności

Cloud GPU wykorzystują silną izolację, aby utrzymać Twoje dane, modele i obciążenia oddzielone od innych najemców. Wirtualizacja zapewnia bezpieczne przetwarzanie na każdym GPU, podczas gdy dostawca chmury zarządza łatkami i środkami ochronnymi w całej podstawowej infrastrukturze.

Większość platform przestrzega uznawanych standardów zgodności, oferując szyfrowanie, kontrolowany dostęp i bezpieczne sieci w różnych środowiskach. Pomaga to utrzymać niezawodną, zgodną usługę podczas skalowania GPU, migracji obciążeń lub integracji z szerszymi narzędziami chmurowymi.

Jak wybrać swój Cloud GPU

Wymagania dotyczące wydajności (pamięć, rdzenie, moc obliczeniowa)

Zacznij od dopasowania pamięci GPU, liczby rdzeni i pojemności przetwarzania do swoich obciążeń. Modele AI, renderowanie i uczenie maszynowe często wymagają wyższej wydajności i bardziej specjalistycznego sprzętu, podczas gdy lżejsze aplikacje mogą działać komfortowo na mniejszych instancjach.

Skalowalność i elastyczność dla zmieniających się obciążeń

Jeśli twoje wykorzystanie się zmienia lub spodziewasz się szybkiego wzrostu, wybierz konfigurację, która łatwo się skalować. Chmurowe GPU ułatwiają dostosowywanie zasobów na żądanie, oferując elastyczność potrzebną do rozwijających się obciążeń, testowania lub wieloetapowych cykli szkoleniowych.

Ocena kosztów i modele cenowe

Porównaj ceny w oparciu o rzeczywiste wzorce użytkowania. Niektóre zespoły preferują rozliczenia godzinowe lub miesięczne, podczas gdy inne korzystają z opcji rezerwacji dla przewidywalnych poziomów obciążenia. Zwróć uwagę na całkowite koszty, w tym przechowywanie i ruch sieciowy, planując aktualizacje lub migrację.

Integracja z istniejącą infrastrukturą chmurową

Upewnij się, że chmurowe GPU płynnie integrują się z twoją obecną infrastrukturą, narzędziami i pipeline'ami wdrożeniowymi. Możesz połączyć instancje GPU z pamięcią, frameworkami orkiestracyjnymi i innymi usługami chmurowymi, aby uprościć operacje.

Szybkości sieciowe i transferu danych

Szybkie sieci są pomocne przy przenoszeniu dużych zbiorów danych lub uruchamianiu rozproszonych modeli. Szukaj opcji o wysokiej przepustowości, niskich opóźnieniach i płynnej integracji w różnych platformach i środowiskach, szczególnie dla infrastruktury AI lub szkolenia wielonodowego.

Wsparcie, niezawodność i SLA

Niezawodne wsparcie i jasne SLA pomagają zapewnić stabilność przez cały cykl życia twojej usługi. Jest to ważne przy uruchamianiu krytycznych aplikacji, zarządzaniu wieloma pipeline'ami lub poleganiu na dostawcy chmurowym w długoterminowych operacjach.

Wdrażanie chmurowych GPU z OVHcloud

Dostępne instancje GPU i konfiguracje

OVHcloud oferuje instancje GPU dostosowane do wszystkiego, od szybkich eksperymentów po duże szkolenia AI i obciążenia o wysokiej wydajności. Możesz wybierać konfiguracje w oparciu o pamięć, potrzeby obliczeniowe lub specyficzne wymagania twoich aplikacji, niezależnie od tego, czy chodzi o uczenie maszynowe, renderowanie czy modele wymagające dużych ilości danych.

Integracja API, automatyzacja i narzędzia orkiestracji

Wdrażanie i skalowanie są proste dzięki dostępowi do API i narzędziom automatyzacji. Pozwalają one na zarządzanie zasobami w sposób spójny w różnych środowiskach, co ułatwia migrację i orkiestrację podczas przenoszenia obciążeń do GPU w chmurze.

Najlepsze praktyki maksymalizacji wydajności i efektywności kosztowej

Aby uzyskać najlepszą równowagę między wydajnością a kosztami, dopasuj typy GPU do swojego obciążenia, monitoruj użycie i unikaj nadmiernego przydzielania zasobów. Łączenie GPU w chmurze z pamięcią masową, siecią i innymi usługami obliczeniowymi w chmurze pomaga utrzymać efektywność podczas skalowania infrastruktury AI lub uruchamiania wielu modeli.

Dostęp do GPU w chmurze z OVHcloud

OVHcloud oferuje skalowalne instancje GPU w chmurze, przewidywalne ceny i łatwą integrację z szerszymi usługami obliczeniowymi w chmurze, co ułatwia uruchamianie modeli AI, potoków uczenia maszynowego i innych obciążeń o wysokiej wydajności bez zarządzania fizycznym sprzętem.

Instancje GPU

Odkryj elastyczne, na żądanie instancje GPU zaprojektowane do szkolenia AI, renderowania i aplikacji wymagających dużej mocy obliczeniowej. Wybierz spośród wielu konfiguracji zoptymalizowanych pod kątem pamięci, mocy obliczeniowej i zaawansowanych obciążeń, aby szybko uruchamiać projekty i łatwo skalować w różnych środowiskach z potrzebną wydajnością.

Dedykowane serwery GPU

Uruchamiaj szkolenie AI i zadania wymagające dużej mocy obliczeniowej na dedykowanych serwerach GPU zaprojektowanych z myślą o maksymalnej kontroli i wydajności. Dzięki wyłącznemu dostępowi do potężnego sprzętu GPU i pełnej personalizacji swojego środowiska, możesz realizować duże modele, zarządzać złożonymi potokami i pewnie skalować od testów do produkcji.

Rozwiązania o wysokiej wydajności

Uzyskaj dostęp do specjalistycznych opcji obliczeniowych do symulacji, analityki, zadań HPC i obciążeń wymagających dużych ilości danych. Te rozwiązania zapewniają spójną wydajność, płynnie integrują się z zasobami GPU i serwerami dedykowanymi, oraz stanowią niezawodną podstawę dla złożonych, wieloetapowych projektów. Możesz je porównać według zastosowania, aby znaleźć to, które najlepiej odpowiada Twoim potrzebom.